- Книги для изучения инженерии данных.

- Основная литература.

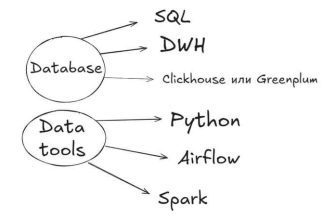

- Практические инструменты и навыки.

- SQL и Базы данных:

- Python и обработка данных:

- Оркестрация:

- Дополнительные рекомендации.

- Пошаговый план обучения на основе этих книг.

- Этап 1: фундамент (базы данных и SQL).

- Этап 2: программирование и ETL (Python)

- Этап 3: масштабирование и архитектура.

- Этап 4: инженерная надежность (Middle+)

Книги для изучения инженерии данных.

Для изучения инженерии данных (Data Engineering) рекомендуется сосредоточиться на книгах, которые охватывают как фундаментальные концепции распределенных систем, так и практические инструменты для построения конвейеров данных.

Основная литература.

Эти книги считаются «золотым стандартом» в индустрии на 2025–2026 годы:

«Основы инженерии данных» (Fundamentals of Data Engineering) — Джо Рейс и Мэтт Хаусли.

- Для кого: новички и специалисты среднего уровня.

- О чем: описывает полный жизненный цикл данных (сбор, хранение, преобразование, предоставление) и учит выбирать технологии под конкретные задачи бизнеса.

«Высоконагруженные приложения. Программирование, масштабирование, поддержка» (Designing Data-Intensive Applications) — Мартин Клеппманн.

- Для кого: инженеры, стремящиеся к уровню Senior.

- О чем: глубокий разбор внутреннего устройства баз данных, принципов репликации, партиционирования и обеспечения надежности распределенных систем.

«Инструментарий хранилища данных» (The Data Warehouse Toolkit) — Ральф Кимболл и Марджи Росс.

- Для кого: все уровни.

- О чем: классическое руководство по многомерному моделированию данных (схемы «звезда» и «снежинка»), которое остается актуальным для современной аналитики.

Практические инструменты и навыки.

Для освоения конкретного стека технологий стоит обратить внимание на следующие издания:

SQL и Базы данных:

- «Изучаем SQL» — Алан Болье. Подходит для быстрого погружения в написание запросов.

- «Введение в системы баз данных» — Кристофер Дейт. Фундаментальный труд по теории СУБД.

Python и обработка данных:

- «Data Engineering with Python» — Пол Крикард. Практическое руководство по созданию ETL-процессов и автоматизации конвейеров на Python.

- «Spark: The Definitive Guide» — Билл Чемберс и Матей Захария. Исчерпывающее руководство по работе с Apache Spark для обработки больших данных.

Оркестрация:

- «Apache Airflow и конвейеры обработки данных» — Бас Харенслак и Джулиан де Руйтер. Обучает автоматизации и мониторингу сложных рабочих процессов.

Дополнительные рекомендации.

Для укрепления базовых знаний в программировании и алгоритмах полезны:

- «Грокаем алгоритмы» (Адитья Бхаргава) — для понимания основ оптимизации кода.

- «Python. К вершинам мастерства» (Лучано Рамальо) — для глубокого понимания языка, основного в инженерии данных.

Пошаговый план обучения на основе этих книг.

Чтобы переход от теории к практике был эффективным, я разбил план на четыре этапа. Двигайтесь по ним последовательно

Этап 1: фундамент (базы данных и SQL).

Прежде чем строить «магистрали» для данных, нужно понять, как данные хранятся и структурируются.

- Что читать: Алан Болье, «Изучаем SQL» + Ральф Кимболл, «Инструментарий хранилища данных».

- Что освоить: основы SQL (JOIN, агрегации, оконные функции) и проектирование таблиц (схемы «звезда» и «снежинка»).

- Практика: попробуйте спроектировать простую базу данных для интернет-магазина в PostgreSQL.

Этап 2: программирование и ETL (Python)

Data Engineer — это в первую очередь разработчик. Python нужен для написания скриптов, которые забирают данные из одного места и перекладывают в другое.

- Что читать: Пол Крикард, «Data Engineering with Python».

- Что освоить: библиотеку pandas (для малых данных), работу с API, чтение/запись форматов JSON, CSV, Parquet.

- Практика: напишите скрипт, который скачивает данные о погоде через API и сохраняет их в вашу базу из первого этапа.

Этап 3: масштабирование и архитектура.

Когда данных становится слишком много для одного компьютера, в игру вступают распределенные системы.

- Что читать: Джо Рейс, «Основы инженерии данных». Это ваша главная книга на этом этапе.

- Что освоить: жизненный цикл данных, понятие Big Data, инструменты распределенной обработки (Apache Spark) и облачные платформы (AWS/GCP/Azure).

- Практика: попробуйте обработать крупный датасет (миллионы строк) с помощью PySpark.

Этап 4: инженерная надежность (Middle+)

Этап для тех, кто хочет строить по-настоящему профессиональные и отказоустойчивые системы.

- Что читать: Мартин Клеппманн, «Высоконагруженные приложения».

- Что освоить: инструменты оркестрации (Apache Airflow), потоковую обработку (Kafka) и принципы работы NoSQL баз данных.

- Практика: настройте автоматический запуск вашего Python-скрипта в Airflow по расписанию.